近日,中国海洋大学信息科学与工程学部(以下简称“学部”)在人工智能内容生成领域取得重要进展,研究成果以“One-for-All: Towards Universal Domain Translation with a Single StyleGAN”(一体通用:单一StyleGAN实现通用视觉域转换)为题,发表于人工智能领域顶级期刊IEEE Transactions on Pattern Analysis and Machine Intelligence (IEEE TPAMI,影响因子20.8)。该研究针对跨域视觉转换中的模型通用性问题,提出了一种有效方案,为复杂场景下的视觉内容生成提供了新的技术路径。

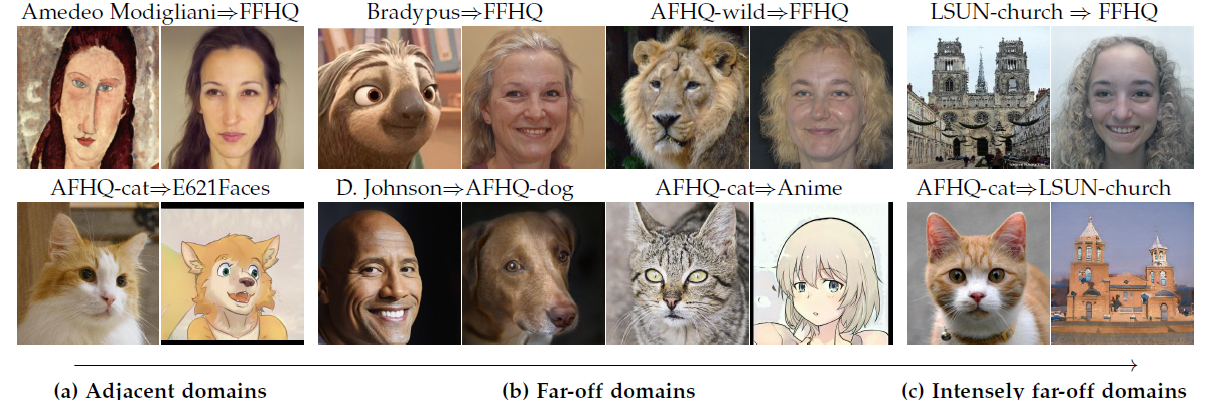

当前视觉域转换技术面临三个核心挑战:其一,传统方法需针对不同任务(如艺术风格迁移、图像语义转换)分别训练专用模型,导致计算资源消耗显著;其二,现有模型对训练数据量需求高,在工业设计、文化遗产数字化等数据稀缺场景中应用受限;其三,当源域与目标域差异较大时(如从孙悟空形象到其庙宇建筑的转换),现有方法常出现语义失真问题。针对上述挑战,研究团队提出基于“语义-生成双空间耦合”框架的UniTranslator模型,通过融合CLIP多模态模型的语义理解能力与StyleGAN的图像生成能力,实现了无需任务定制训练、无需依赖大量训练数据、适应高异质性跨域场景的通用转换。

图1 UniTranslator框架示意图

图2 UniTranslator效果示例

该模型的核心创新包括两方面:首先,构建跨域特征对齐系统,利用CLIP模型提取图像深层语义特征,建立跨视觉域的语义关联;其次,设计隐空间桥接机制,通过量化CLIP与StyleGAN隐空间的分布特性,实现语义到视觉特征的动态转化。实验结果表明,在人物肖像卡通化、艺术风格迁移等任务中,模型可在保持原始图像拓扑结构的前提下准确呈现目标域特征。在与谷歌研究院的合作测试中,团队还进一步验证了模型在动态手势驱动建筑形态生成等复杂场景中的有效性。

此项研究由学部董军宇教授领衔的视觉理解与生成团队(VUG@OUC)主导完成,第一作者和通讯作者为2021级计算机技术专业硕士生展家慧及学部都勇副教授。研究工作获国家自然科学基金、山东省自然科学基金资助,并与新加坡管理大学、英国南安普顿大学、美国加州大学等国际团队开展合作。课题组近年来在计算机视觉领域持续攻关,已于CVPR、ICCV、ECCV、AAAI、IEEE/ACM Trans.系列等顶会顶刊发表多项研究成果,逐步构建从视觉理解到生成应用的完整技术体系,为本次突破提供了重要支撑。

信息科学与工程学部近年来在人工智能领域持续发力,通过建设人工智能研究院、设立人工智能交叉学科博士点等一系列举措,不断增强数智技术底座基础,为赋能学校学科建设、人才培养和科学研究注入了新的动力。

文章链接:https://ieeexplore.ieee.org/document/10848371/

计算机科学与技术学院供稿

初审:夏辉

复审:徐君岭